人類滅亡の可能性も。AIのリスクについてOpenAIやGoogleの元/現従業員が共同声明

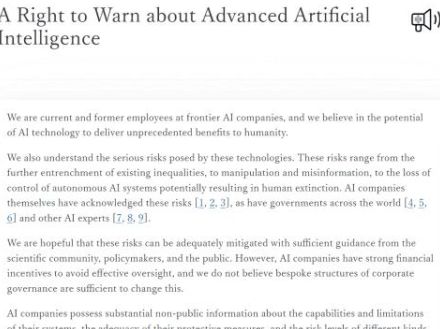

AI技術の進展とリスクについての共同声明がOpenAIおよびGoogleの元/現従業員によって発表された。

声明ではAIの危険性やリスク管理の重要性が強調され、既存の不平等の固定化や自律AIシステムによる制御喪失などが指摘された。

声明にはAI企業に対する要求事項も含まれ、AIリスク関連の懸念に対する適切な対応や情報共有の重要性が述べられている。

OpenAIおよびGoogleの元/現従業員は、AI技術の進展とそれに伴うリスクについての共同声明を発表した。声明では、AIがもたらす危険性やそのリスクを管理するための必要性が強調されている。

声明ではAI技術のリスクとして、既存の不平等をさらに固定化したり、誤情報を拡散したりすることが挙げられているほか、自律AIシステムの制御喪失により人類滅亡の可能性があることも指摘している。

声明の発表者らは、科学界や政策立案者、一般市民からの適切な指導があれば、これらのリスクは十分に軽減できると期待している。しかし、AI企業には効果的な監視を回避する強い財政的インセンティブがあり、現行の企業統治だけではこれを変えるのには不十分であると主張している。AI企業が保有する非公開情報は膨大であり、その情報共有の義務は弱い現状も問題視している。

発表者らは声明内で、AI企業に対して以下の4つの原則に従うように要求している。

・AIリスク関連の懸念を理由とした、自社への批判を禁止する契約を結ばず、報復も行なわないこと

・従業員が匿名でAIリスク関連の懸念を提起できるプロセスを整備すること

・オープンな批判文化を支持し、AIリスク関連の懸念を一般人や企業の取締役会、規制当局、独立組織に提起できるようにすること

・機密情報を不必要に公開することは避けるべきだが、適切な報告プロセスが存在しない場合に公に懸念を報告しても報復措置を取らないこと