Microsoft、マルチモーダルなSLM「Phi-3-vision」をプレビュー

MicrosoftはSLM「Phi-3」ファミリーの新メンバー「vision」を発表した。画像を解析するマルチモーダルなSLMで、リソースが限られる環境でも利用可能。

visionはコンパクトでモバイル端末向けに最適化されており、画像とテキストを一緒に処理するタスクに適している。また、Microsoft Azure上での利用も可能。

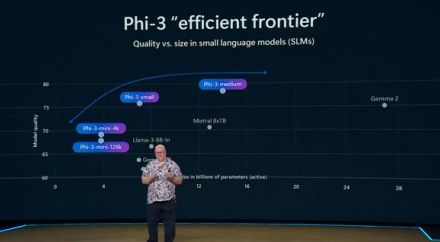

visionはPhi-3-miniを元に開発され、他にもsmallやmediumといったバリエーションがある。開発者はさまざまなアプリやサービスでPhi-3を活用することができる。

米Microsoftは5月21日(現地時間)、開発者向け年次開発者会議「Microsoft Build 2024」の基調講演で、SLM(小規模言語モデル)「Phi-3」ファミリーの新メンバー「Phi-3-vision」(以下「vision」)を発表した。画像を解析するマルチモーダルなSLMだ。プレビュー版を利用可能。

SLMは単純なタスクで適切に実行できるように設計されており、リソースが限られる組織や端末上でローカルに実行する必要があるアプリに適した言語モデルだ。

visionは、描画はできないが、モバイル端末で利用可能なコンパクトさだ。42億パラメータモデルで、グラフや画像に関して質問すると、それについて説明してくれる。

Microsoftは「visionは画像とテキストを一緒に検討する必要があるタスクに最適だ」としている。多様なハードウェアで実行できるように最適化されており、開発者はモバイル端末やWebを含むアプリやサービスでPhi-3を展開できる。

visionは4月発表のPhi-3-mini(38億パラメータ)の言語機能をベースに構築されている。4月には、miniの他、small(70億パラメータ)、medium(140億パラメータ)が発表され、3サイズ展開だった。

smallとmediumも同日からMicrosoft Azureで利用可能になった。