グーグルがGeminiで狙う「スマホのパラダイムシフト」。Google幹部とKDDI社長に聞くその成否

グーグルは、AIを活用したスマートフォンのパラダイムシフトを強調し、Pixel 9シリーズを発表。

新たなAI機能「Gemini Live」や「Call Notes」「Pixel Screenshot」などが注目される。

今後のAI時代に向けた変化が消費者にメリットをもたらす段階に進んでいる。

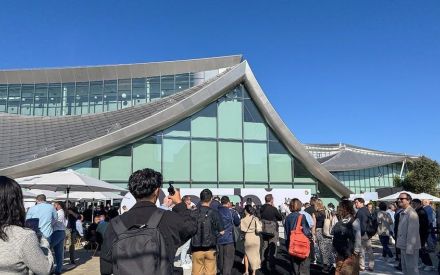

グーグルは8月13日(現地時間)、スマートフォン「Pixel 9」シリーズをはじめとした自社ブランドハードウェアを発表するイベント「Made By Google」を、アメリカ・マウンテンビューにあるグーグル本社で開催した。

そこでグーグルがアピールしたのは「AIによる、スマートフォンのパラダイムシフト」だ。

製品は日本でも順次発売され、すでに詳細が公開されているが、グーグルが2024年に入って主張してきた、同社製AIである「Geminiの時代」をさらに強化するものとなった。

発表会後、記者向けに開催された同社エグゼクティブに対するラウンドテーブル取材では、グーグルの狙いがより明確に説明された。

また、発表会場ではKDDIの髙橋誠社長に取材することもできた。

日米のエクゼクティブが「AI時代とスマホ」をどう見ているのか解説する。

Pixelという新しいハードウェアが出ると、多くの人は「どんなデザインか」「どんなスペックなのか」に注目する。

もちろん重要な要素であることは間違いない。

しかし、今回の発表会では「ハードウェアだけから生まれる価値」はそこまでアピールされていない。

スマートフォンは「ハード」+「ソフト」+「サービス」でできている。そしてそこに「AI」の要素が入ってきた。

グーグルのシニア・バイスプレジデントのRick Osterloh(リック・オステルロー)氏は、現状を「コンピューティングに関するパラダイム・シフトの只中にいる」と説明する。

「私たちの目的は、AIをすべての人の役に立つものにすることであり、AndroidとPixelの体験を、可能な限り素晴らしいものにしようとしています」(オステルロー氏)

そこで鍵を握るのは、同社のAIである「Gemini」によって、どのぐらい今までとは異なる体験ができるのか、ということだ。

発表会で説明された機能の中でも注目されたのは、音声による対話技術である「Gemini Live(日本語名:Gemini ライブチャット)」だ。

現状は英語のみでの提供となるが、従来のGoogleアシスタントやGeminiよりもさらに自然な対話になっている。

UXとGeminiを担当するバイスプレジデントのJenny Blackburn(ジェニー・ブラックバーン)氏は、「今まさに、GeminiがパーソナルAIアシスタントになりつつある」と説明する。

「これまでの音声技術では、まず『何を言おうとしているのかを考える』必要がありました。

しかしGemini Liveでは、完璧なフレーズでなくても、思っていることを言うだけで理解してくれます」(ブラックバーン氏)

さらに、Pixel 9では、通話を書き起こしてサマリーを作る「Call Notes」や、スクリーンショットに含まれる文字や内容を認識、検索・分類する「Pixel Screenshot」が搭載される。(どちらも現状英語のみの提供)

従来、スマホの中の情報の多くは「結局人間が見聞きして判断」する必要があった。

だが、GeminiのようなAIが絡んでくることで、「記録しておいて後から簡単に確認する」「次の行動をAIと共に進める」ことが可能となっている。

こうした変化こそが、オステルロー氏のいう「パラダイムシフト」そのものなのだ。

ただ、まだどの機能もスタートしたばかりで完璧ではない。どう使えばいいのか、どの機能が明確に「消費者に刺さる」のかという答えは出ていない。

パラダイムシフトが消費者に対するメリットになる「少し前」、というのが実情だろう。

記者から「どのような機能が消費者にとって刺さる機能になるのか」と質問されると、オステルロー氏は「明確に1つに絞って答えることはできないし、その指針を計測する方法もない」と説明した。

ただそれは後ろ向きなコメントというわけではない。

「どんなことにもAIを使っていく、ということがポイントであり、どこに大きな影響を与えるかが見えてきたところです。

私は25年間モバイル関連事業が関わってきましたが、Gemini Liveは過去に経験した最大の変化であり、スマートフォンとの関わりを変えてしまうでしょう」(オステルロー氏)