AIで作るニセ画像・ニセ動画・ニセ音声「ディープフェイク」氾濫の脅威 まんまと騙され社会混乱、ニセモノ見抜くには

ディープフェイクとは、AIを使って本物と見分けがつかないフェイクコンテンツを作成する技術であり、悪用が増えている。

AIの進化により、人間由来の情報を使って学習するAIの性能が向上し、本物と見分けがつかないフェイクコンテンツが増加している。

フェイクコンテンツの作成技術はさまざまで、主に人物の顔を対象とする場合、5つのタイプに大別される。

「アメリカ国防省の近くで爆発が起きたとするフェイク画像が拡散され、ダウ平均株価が一時下落」

「台風の豪雨により静岡県で水害が起きた際、町全体が水没したかのようなニセ画像が拡散され、県が冷静な対応を取るよう注意喚起を行った」

「フェイク音声で上司になりすました犯人から電話。ニセ者と気づかず、イギリスのエネルギー企業のCEOが現金を送金してしまった」

こうしたAIによって作られたニセ画像・ニセ動画・ニセ音声などの「ディープフェイク」が巧妙化している。

ディープフェイクとは、機械学習の1つのディープラーニングとフェイクを組み合わせた造語。もともとは画像や動画を合成して新たなコンテンツを作成する技術だったが、現在ではAIを使い本物と見紛うフェイクコンテンツを作成して悪用するケースが増えている。

■本物と見分けがつかないフェイクコンテンツが増加

以前からニセ画像・ニセ動画・ニセ音声そのものは存在したが、かつては人間が目視で確認したり、音声を聞いたりすれば不自然だと判断できるものが多かった。

「顔や音声、体、言語など人間由来の情報を手に入れやすくなっているのはもとより、その情報を使って学習するAIの性能が進化している。AIに人間由来の情報を安価に作ってもらうことも可能になり、2018年頃から目視では本物と見分けがつかないフェイクコンテンツが増えていった」と国立情報学研究所シンセティックメディア国際研究センター長の越前功氏は話す。

つまり、作ろうと思えば、誰でもすぐに欲しいコンテンツが作れるような状況になっている。

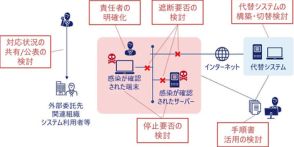

だが、ひとくちにフェイクコンテンツと言っても、それらの作成に使われる技術はさまざま。例えば、人物の顔を対象としたフェイクコンテンツは、次の5つのタイプに大別できるという。

① 現実世界に存在しない顔全体をゼロから生成するもの

② 実在するターゲットの顔画像をもとに、髪の色や表情などを変更した画像を生成するもの

③ 実在するターゲットの顔の画像や動画に、攻撃者の表情を合成するもの

④ 実在するターゲットの画像や映像に、音声やテキストを合成することで、その人が話しているように見せかけるもの