# ハルシネーション

2024.07.19

人間はなぜ「生成AI」に「意識がある」かのように感じてしまうのか…過剰な愛着や恐れを抱かないため「AIとの適切な距離感」

生成AIを使う際には、「ハルシネーション(幻覚)」に注意が必要だと言われる。これは生成AIに何らかの質問をした際、そのAIが事実ではないことを、あたかも事実であるかのように回答してしまう現象を指す。まるでAIが幻覚を見ているかのように感じられるので「ハルシネーション」というわけだ。

2024.07.01

KDDIとNICT、通信品質改善に活用できるLLM

KDDIと情報通信研究機構(NICT)は1日、大規模言語モデル(LLM)に関する共同研究を開始した。LLMの課題となるハルシネーション(事実と異なる内容の生成)を抑制するほか、地図画像や建物情報などのマルチモーダルデータの取り扱いを可能とする技術を開発する。NICTが蓄積している

2024.06.28

GPT-4でGPT-4のエラーを見つける「CriticGPT」

OpenAIは、ChatGPTが出力するエラーを発見するため、GPT-4をベースとした「CriticGPT」を開発した。AIを使ってAIのミスを発見するのを支援するツール。GPT-4シリーズのモデルは、RLHF(人間からのフィードバックによる強化学習)を使って訓練されているが、A

2024.05.23

アンスロピックが「AIのブラックボックス」解読に初めて成功…「AIのもっともらしい嘘減らせる」

オープンAIの対抗馬とされるアンスロピックが人工知能(AI)の「ブラックボックス」を開いた。これまでわかりにくかったAIの作動原理を一部把握し、より安全なAIを作ることができるという研究結果を発表しながらだ。生成AIの致命的弱点に挙げられてきハルシネーション(幻覚)や偏向問題を解決できるか関心

2024.05.20

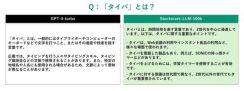

国内最大級1000億パラメーターのAIモデル、ベンチャー開発 “幻覚”少なく

ストックマークは5月16日、ハルシネーションを大幅に抑止した1000億パラメータ規模の大規模言語モデル(LLM)「Stockmark-LLM-100b」を商用利用可能なオープンソースで公開した AIスタートアップのストックマークは5月16日、ハルシネーションを大幅に抑止した100